"AI '게임의 룰' 전쟁 격화…표준화 뒤처지면 기업 설자리 없어"

-

기사 스크랩

-

공유

-

댓글

-

클린뷰

-

프린트

ISO 인공지능 국제표준총회

전문가 5인 제언

성능·신뢰성 평가 국제기준 없어

기업들 제품·서비스 수출 난항

서구권 중심의 AI표준 설정 위협

韓기업에 유리한 기준 마련해야

전문가 5인 제언

성능·신뢰성 평가 국제기준 없어

기업들 제품·서비스 수출 난항

서구권 중심의 AI표준 설정 위협

韓기업에 유리한 기준 마련해야

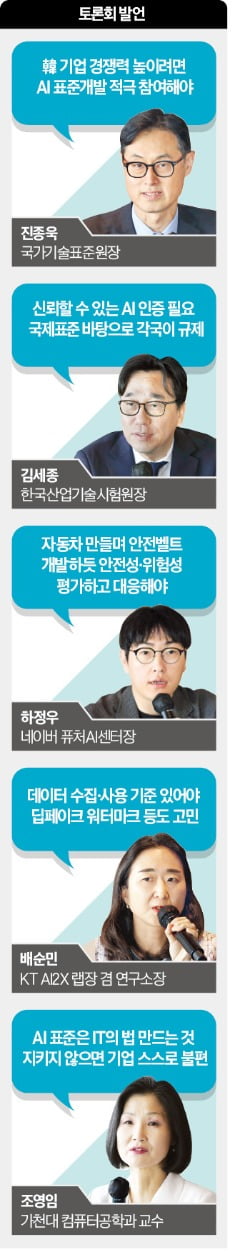

좌담회에는 진종욱 국가기술표준원장, 김세종 한국산업기술시험원장, 하정우 네이버 퓨처AI센터장, 배순민 KT 책임감 있는 AI센터장 겸 AI2X 랩장·연구소장, 조영임 가천대 컴퓨터공학과 교수 등이 참석했다. 이상은 한국경제신문 사회부 차장이 사회를 맡았다.

▷사회=AI 표준화라는 표현이 모호하게 들리기도 한다. 어떤 의미인가.

▷진 원장=세계 각국에서 AI 개발 경쟁이 이어지며 AI를 이용한 제품과 서비스의 신뢰성·안전성을 확보해야 할 필요성이 커졌다. 또 우리가 공통으로 사용하는 기준이 없다면 AI 시스템의 상호 운용성과 호환성을 갖기 힘들다. 다른 영역과 마찬가지로 AI에도 표준 개념이 필요하고 미국과 유럽연합(EU)은 이미 이런 준비를 하고 있다.

▷하 센터장=AI 영역의 발전 속도가 너무 빠르기 때문에 특정한 기술, 특정 방법론을 표준화한다는 개념은 맞지 않다는 인식이 적지 않았다. 이런 상황에서 특정 기술을 표준으로 정하면 전체 기술 발전 속도가 늦춰지는 단점이 더 크다고 봤다. 하지만 최근에는 이런 인식이 달라지고 있다. AI 기술이 워낙 다양하게 등장하기 때문에 서로 비교 평가할 필요가 커졌다. 성능 평가, 신뢰성 평가를 해야 하는데 기준이 없는 데 따른 혼란이 크다는 것을 체감하고 있다. AI의 투명성, 안전성, 위험성에 대해서도 공통적인 기준이 생겨야 하는 시점이다. 다음달 11~12일 한국에서 AI 안전성 정상회의(AI safety summit)가 열리는 것도 공통적인 인류 보편의 가치에 관해 논의할 필요성이 커지고 있다는 의미다.

▷김 원장=어떤 것이 신뢰성 있는 제품이 되는지를 결정하는 게 바로 표준의 영역이다. 각종 수요를 검증하고 인증하는 기관들이 존재하는 이유다. 산업 현장에서는 AI를 활용한 제품과 서비스를 개발할 때 기준이 없어 어려움이 있다. 국내 기업이 AI 제품을 개발했다고 하더라도 그 제품을 해외에 수출하는 데 문제가 없도록 하려면 공통적인 기준을 지켰다는 점을 설명할 수 있어야 한다. 국제적인 인증 시스템 정립이 시급하다.

▷사회=AI국제표준화위원회에선 어느 정도의 논의가 이뤄지고 있는가.

▷조 교수=위원회는 AI의 국제표준에 대한 컨트롤타워다. 딥마인드의 ‘알파고’가 설립(2017년) 계기였다. 당시에는 큰 진전이 없다가 챗GPT의 등장으로 진짜 AI 전문가들이 합류하기 시작했다. 지난해 AI 관련 기업들의 관심을 받은 AI 경영시스템(ISO/IEC 42001) 국제표준 제정을 마쳤다. 기업이 AI 관리 체계를 어떻게 수립·구현하고 개선해야 하는지에 관한 내용을 담은 것이다. 지금은 AI 시스템 영향평가, 기능안전, 품질평가 등에 관한 표준 개발을 진행하고 있다.

▷하 센터장=네이버도 이 위원회에 적극적으로 참여할 계획이다. 기술 운영과 개발이 책임감 있고 안전하게 이뤄지는지 평가해야 한다. 기업들이 제각기 ‘난 잘하고 있다’고 우기게 놔두면 안 되며 정확한 기준으로 평가하고 검증받아야 한다. 안전성이든 성능이든 마찬가지다.

▷배 소장=가치 중립적인 AI를 개발하려는 이들은 ‘책임성’이라는 표현에 거부감을 느낄 때도 있다. 하지만 일반인들은 AI 기술이 아니라 AI 기업의 ‘윤리’ 측면에서 AI의 위험성을 판단한다. AI 데이터를 수집하는 방법에 대한 공통된 기준도 필요하다. AI가 활용된 딥페이크 여부를 표시하는 워터마크를 단다든지 하는 문제도 표준화에서 논의돼야 하는 부분이다.

▷사회=표준의 구속력은 어떻게 생기나.

▷김 원장=각국이 이런 표준에 근거해서 규제를 만들기 때문에 구속력이 생긴다.

▷조 교수=지키지 않으면 기업들이 스스로 불편할 것이다. 또 상황 변화에 맞춰 표준도 몇 년에 한 번씩 업데이트해야 한다.

▷사회=기업이 스스로 기술을 통제할 수 있는 능력이 있는지도 의문이다.

▷하 센터장=기술이 나쁜 결과를 낳을 가능성에 대한 대응책을 마련하는 것도 기업이 할 일이다. 자동차를 개발한 다음에 안전벨트를 만드는 것과 마찬가지 이치다. 교통정리해야 할 문제가 많다. 미국, 서구권 중심으로 AI가 통일되는 것은 위험하다. 적극적으로 한국이 목소리를 내고 우리 스스로 AI 개발에 참여할 필요가 있다.

이상은/최해련 기자 selee@hankyung.com