영화 'Her' 현실로…사람처럼 감정 담아 대화하는 AI 나온다

-

기사 스크랩

-

공유

-

댓글

-

클린뷰

-

프린트

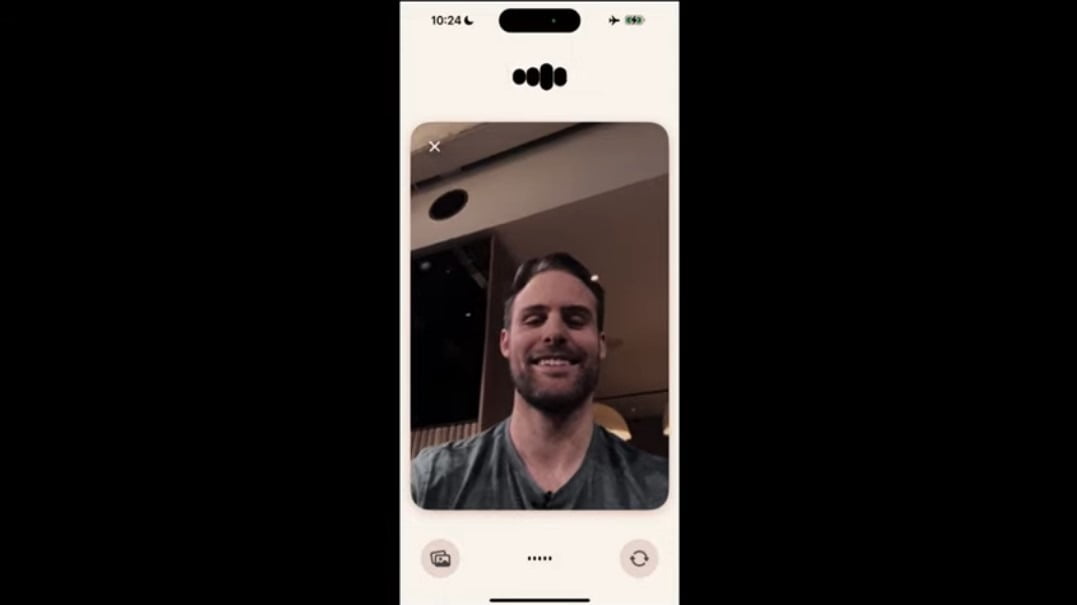

"실시간 대화하는 GPT-4o 출시"

구글 행사 전날 선제공격 나선 오픈AI

구글 행사 전날 선제공격 나선 오픈AI

오픈AI는 13일(현지시간) 온라인으로 진행된 ‘스프링 업데이트’ 행사를 통해 최신 대규모언어모델(LLM) ‘GPT-4o’를 공개하고 직접 성능을 시연했다. 작년 11월 GPT-4터보를 공개한 지 6개월여 만이다. ‘o’는 모든 것을 뜻하는 ‘옴니(Omni)’에서 따왔다. GTP-4o는 텍스트 위조로 대화하는 기존 챗봇에서 한 단계 더 나아갔다. 사용자와 실시간으로 대화하면서 질문과 답변을 받을 수 있다. 사용자의 말투와 억양을 분석해 현재 상태도 파악할 수 있고, 이미지도 실시간 분석해 수학문제의 답을 맞힐 수도 있다. 미라 무라티 최고기술책임자(CTO)는 “GPT-4o는 GPT-4의 성능을 보다 빨리 구현하는 데 초점을 맞춘 모델”이라며 “텍스트, 시각, 청각 데이터를 종합적으로 분석하고 처리할 수 있도록 했다”고 설명했다.

또 다른 엔지니어는 “수면장애가 있는데 잠이 잘 오는 이야기를 들려달라”고 요청했다. 이에 GPT-4o는 이야기를 들려줬고, 엔지니어들은 다양한 분위기와 감정으로 목소리를 변형했다. 챗봇은 구연동화 톤의 목소리는 물론 로봇과 같은 소리로도 이야기를 들려줬다.

이번 행사는 캘리포니아 마운틴뷰 본사에서 열리는 구글의 연례 개발자 회의 I/O 행사 하루 전에 기습적으로 진행됐다. AI 시장의 최대 경쟁자인 두 회사가 힘겨루기를 하는 모양새다. 구글도 이번 행사를 통해 이전보다 업그레이드된 AI 모델을 내놓을 예정이다.

실리콘밸리=최진석 특파원 iskra@hankyung.com