'HBM 3위' 마이크론 맹추격…삼성·하이닉스는 '기술 초격차' 속도

입력

수정

지면A10

HBM 공개 앞둔 美마이크론“경쟁사 제품 대비 소비 전력이 30% 적고 성능은 10% 좋은 HBM3E(5세대 고대역폭메모리)를 고객사에 납품할 것이다.”(산제이 메로트라 마이크론 최고경영자)

"경쟁사보다 성능 30% 월등"

뜨거워지는 AI 칩 성능 경쟁

삼성·하이닉스, HBM4 주력

인텔 , 4배 빠른 가속기 내놓고

"엔비디아 시대 저물 것" 저격

마이크론, 인텔 등 인공지능(AI) 반도체 시장의 3위권 기업들이 선두권 추격을 위한 파상공세에 들어갔다. 자사가 개발 중인 신제품 성능을 부각하는 데 그치지 않고 1~2위권 업체의 제품을 깎아내리는 것도 불사한다. 엔비디아(AI 가속기), 삼성전자·SK하이닉스(HBM) 등 각 분야 선두 업체들은 신기술 도입을 통한 격차 벌리기에 주력하고 있다.

마이크론 HBM3E 승부수

24일 반도체업계에 따르면 D램 세계 3위 업체 미국 마이크론은 HBM3E를 개발해 주요 고객사의 품질 검사를 받고 있다. HBM은 D램을 여러 개 쌓아 데이터 처리 용량과 속도를 높인 AI 서버용 메모리 반도체다. HBM 시장 규모는 올해 약 2조5000억원에서 2028년 8조원 수준으로 커질 전망이다글로벌 HBM 시장은 삼성전자와 SK하이닉스가 양분하고 있다. 마이크론의 점유율(2023년 전망치 기준)은 5% 수준으로 3위다. 마이크론은 선두 추격을 위해 차세대 제품인 HBM3E에 모든 역량을 집중하는 승부수를 띄웠다. 산제이 메로트라 최고경영자(CEO)는 “엔비디아의 차세대 AI 가속기에 HBM3E를 납품하기 위해 마지막 검증 단계를 진행 중”이라고 말했다.

인텔, “엔비디아의 성공은 우연”

HBM과 그래픽처리장치(GPU) 등을 패키징(여러 칩을 한 칩처럼 작동하게 하는 공정)한 ‘AI 가속기’ 시장에서도 주도권 경쟁이 치열하다. AI 가속기는 대규모 데이터 학습·추론에 특화된 반도체로 생성형 AI 시대 필수재로 불린다.인텔이 안간힘을 쓰고 있다. 인텔은 지난 14일 차세대 AI 가속기 ‘가우디3’ 시제품을 공개했다. 전 세대 제품보다 속도는 최고 4배 빠르고 HBM은 1.5배 늘려 적용한 것이 특징이다. 팻 겔싱어 인텔 CEO는 AI 가속기 강자인 엔비디아에 대한 저격도 서슴지 않고 있다. 그는 “데이터 추론(서비스)용 반도체의 중요성이 커지면 데이터 학습에 특화된 엔비디아의 시대도 저물 것”이라고 주장했다.

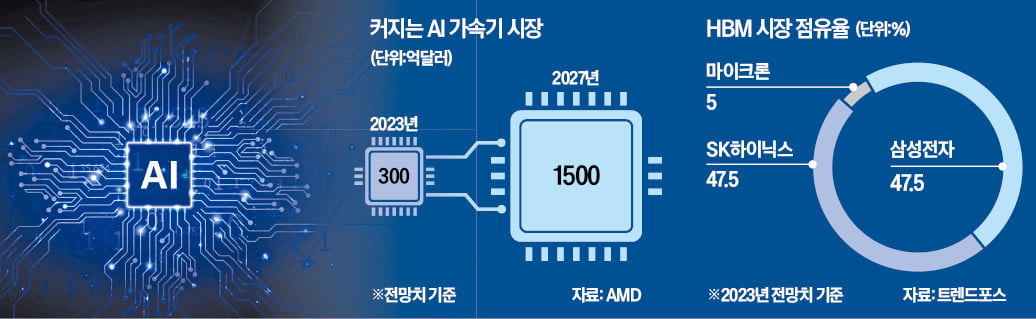

삼성·SK ‘신기술 승부수’

AI 반도체 각 부문에서 ‘3등의 반격’이 치열한 건 시장의 성장성 때문이다. AMD에 따르면 올해 300억달러(약 40조원) 규모인 AI 가속기 시장은 2027년 1500억달러(약 195조원)로 확대될 전망이다. HBM 시장은 향후 5년간 매년 50% 커질 것이란 전망도 나온다.1위 업체의 횡포를 견제하기 위한 고객사들의 요청도 후발주자의 공격적인 시장 진출을 이끄는 요인으로 분석된다. 예컨대 마이크로소프트 등 AI 가속기 시장의 큰손들은 AMD, 인텔 등에 엔비디아 대체재 개발을 종용하고 있다. HBM 시장에선 한 고객사가 마이크론에 6억달러(약 7800억원) 규모 선급금을 지급하며 신제품 개발을 지원했다.시장 주도업체들은 신제품을 통한 격차 벌리기에 주력하고 있다. HBM 시장에선 삼성전자, SK하이닉스가 6세대 HBM인 HBM4를 개발 중이다. 제품 용량을 키우면서 크기를 작게 만들 수 있는 ‘하이브리드 본딩’ 기술을 적용할 것으로 전망된다. 엔비디아는 2025년 메모리 사용량을 400기가바이트(GB)로 높인 ‘X100’ AI 가속기를 개발 중이다.

황정수 기자 hjs@hankyung.com