'인공지능 윤리' 점검 나선 테크업계

입력

수정

지면A14

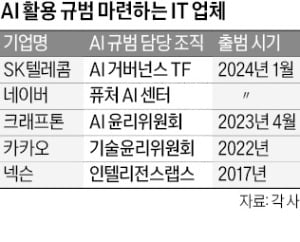

SKT, 3월내 AI 업무 지침 수립최근 인공지능(AI)을 업무와 서비스·제품에 도입하는 기업이 빠르게 늘면서 AI가 가져올 수 있는 부작용에 대한 고민이 커지고 있다. 부작용을 최소화하기 위해 기업 내부적으로 AI 윤리를 강화하는 움직임이 빨라지고 있다. 정보기술(IT) 및 게임 업계를 중심으로 사업 전반에 AI를 어떻게 활용할지 내부 규범을 마련하고 전담 조직도 신설하는 모습이다.

네이버는 AI 리스크 조직 신설

크래프톤·넥슨도 규범 마련키로

네이버도 지난주 조직 개편을 하면서 퓨처AI센터를 세웠다. 하정우 네이버클라우드 AI이노베이션센터장이 신설 센터의 수장을 겸한다. 신설 센터는 AI의 안전성을 담보하기 위한 정책 부서 성격이 강하다. 카카오도 2022년 설립한 기술윤리위원회를 통해 지난달 자체 기술윤리 보고서를 처음 발간했다.

게임업계도 AI 규범 확립에 힘을 쏟고 있다. 크래프톤은 지난해 4월 AI윤리위원회를 설치했다. 게이머들의 AI 콘텐츠 과몰입, AI의 이념 편향 등을 해결하기 위해서다. 넥슨은 2017년 세운 기술윤리위원회에서 AI 관련 윤리 정책을 담당하고 있다. 업계 관계자는 “과거엔 AI 기술 확보가 화두였지만 최근엔 AI 서비스가 야기할 수 있는 윤리 문제를 어떻게 관리하느냐가 고민거리”라며 “해외에선 기업들의 AI 거버넌스 확립을 지원하는 컨설팅업체도 생겨나고 있다”고 말했다.

이주현 기자 deep@hankyung.com